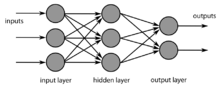

Djupinlärning (även kallad djup strukturerad inlärning eller hierarkisk inlärning) är en typ av maskininlärning som främst används med vissa typer av neurala nätverk. Precis som med andra typer av maskininlärning kan inlärningssessioner vara oövervakade, halvövervakade eller övervakade. I många fall är strukturerna organiserade så att det finns minst ett mellanskikt (eller dolt skikt) mellan inmatningsskiktet och utmatningsskiktet.

Vissa uppgifter, t.ex. att känna igen och förstå tal, bilder eller handskrift, är lätta att utföra för människor. För en dator är dessa uppgifter dock mycket svåra att utföra. I ett neuralt nätverk med flera lager (med fler än två lager) blir den information som behandlas mer abstrakt för varje lager som läggs till.

Modeller för djupinlärning är inspirerade av informationsbehandlings- och kommunikationsmönster i biologiska nervsystem. De skiljer sig på många sätt från de strukturella och funktionella egenskaperna hos biologiska hjärnor (särskilt den mänskliga hjärnan), vilket gör dem oförenliga med neurovetenskapliga bevis.

Hur det fungerar i korthet

Grundidén i djupinlärning är att bygga modeller som kan lära sig flera nivåer av representation — från enkla funktioner till mer komplexa och abstrakta — genom att stapla många lager av artificiella neuroner. Träningen går vanligtvis till så här:

- Framåtriktad beräkning: Data skickas genom nätverkets lager för att producera en förutsägelse.

- Förlustberäkning: Skillnaden mellan förutsägelsen och det korrekta svaret mäts med en förlustfunktion.

- Backpropagation: Fel signalfördelas bakåt genom nätverket för att räkna ut gradienter.

- Optimering: En optimeringsalgoritm (t.ex. SGD, Adam) justerar vikterna för att minska förlusten.

Vanliga arkitekturer

- Konvolutionella neurala nätverk (CNN): Särskilt bra för bildbehandling och datorseende.

- Rekurrenta neurala nätverk (RNN) och LSTM/GRU: Används för sekvensdata som tal och text (tidigare vanliga; delvis ersatta av Transformer-modeller).

- Transformer-modeller: Nuvarande standard för många uppgifter inom naturlig språkbehandling (NLP) och även för vissa bilduppgifter.

- Autoenkodare: För representationinlärning och dimensionreduktion.

- Generativa adversariella nätverk (GAN): Används för generering av realistiska bilder och data.

Typer av inlärning

- Övervakad inlärning: Modell tränas med märkta exempel (input + korrekt output).

- Oövervakad inlärning: Ingen märkning; modellen söker mönster och strukturer i data.

- Halvövervakad inlärning: Kombination av få märkta och många omärkta exempel.

- Reinforcement learning (förstärkningsinlärning): Agent lär sig genom belöningar och straff; djupRL kombinerar detta med djupa nätverk.

Träningstekniker och förbättringar

För att få djupa nätverk att prestera bra används en rad tekniker:

- Normalisering: Batch normalization, layer normalization m.fl. för stabilare och snabbare träning.

- Regularisering: Dropout, viktdecay och tidig stoppning för att motverka överanpassning.

- Databerikning (data augmentation): Skapa fler träningsexempel genom rotation, skalning, brus m.m.

- Förtränade modeller och finjustering: Återanvändning av modeller tränade på stora dataset för att spara resurser och förbättra resultat på nya uppgifter.

Tillämpningar

Djupinlärning används inom många områden, bland annat:

- Bild- och videobearbetning (objektigenkänning, segmentering, bildgenerering)

- Talsyntes och taligenkänning

- NLP: maskinöversättning, textgenerering, frågesvarssystem

- Medicinsk bildanalys och diagnostikstöd

- Autonoma fordon och robotik

- Rekommendationssystem och personalisering

- Finansiell modellering, riskbedömning och fraud-detektion

Fördelar och begränsningar

- Fördelar: Mycket bra på att hitta mönster i stora och komplexa datamängder; kan automatisera uppgifter som tidigare krävde mänsklig expertis.

- Begränsningar: Kräver ofta stora mängder märkta data och mycket beräkningskraft; modeller kan vara svåra att tolka (”black box”); känsliga för snedvridningar i data och för adversariella attacker.

Etiska och praktiska överväganden

- Bias och rättvisa: Om träningsdata innehåller systematiska snedvridningar kan modellerna reproducera eller förstärka dessa.

- Integritet: Användning av persondata ställer krav på lagar, etik och säker hantering.

- Energi och resurser: Träning av mycket stora modeller kräver betydande energi och kan ha miljökonsekvenser.

- Tolkbarhet: I många tillämpningar är det viktigt att kunna förklara modellens beslut, särskilt i kritiska domäner som sjukvård och juridik.

Sammanfattning

Djupinlärning är en kraftfull del av modern maskininlärning som bygger på flerskiktade neurala nätverk för att lära sig komplexa representationer ur data. Tekniken har revolutionerat många områden men ställer också krav på data, beräkningsresurser och noggrann etisk hantering. Modellerna är inspirerade av biologiska nervsystem, men skiljer sig i både struktur och funktion från biologiska hjärnor, vilket gör dem till verktyg som bäst förstås och används med insikt om deras begränsningar.