Biologin bakom förstärkningsinlärning finns på Operant konditionering och belöning.

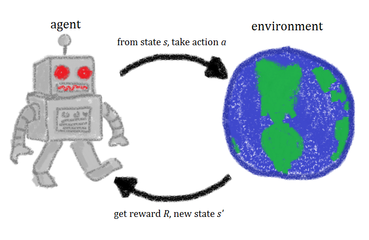

Förstärkningsinlärning (Reinforcement Learning, RL) innebär att man lär en mjukvaruagent hur den ska bete sig i en miljö genom att tala om för den hur bra den gör det. Det är ett område inom maskininlärning som är inspirerat av beteendepsykologi.

Förstärkningsinlärning skiljer sig från övervakad inlärning eftersom de korrekta ingångarna och utgångarna aldrig visas. Dessutom lär sig förstärkningsinlärning vanligtvis under tiden (onlineinlärning) till skillnad från övervakad inlärning. Detta innebär att en aktör måste välja mellan att utforska och att hålla sig till det som den känner till bäst.

Grundläggande begrepp

Följande termer återkommer ofta inom RL:

- Agent — den som fattar beslut (t.ex. ett program eller en robot).

- Miljö — allt utanför agenten som påverkar resultatet och som agenten interagerar med.

- Tillstånd (state) — en beskrivning av miljön vid en given tidpunkt.

- Handling (action) — ett beslut agenten kan ta i ett tillstånd.

- Belöning (reward) — signal som talar om hur bra en handling var; agentens mål är att maximera den sammanlagda belöningen.

- Policy — en strategi som beskriver hur agenten väljer handlingar (kan vara deterministisk eller stokastisk).

- Värdefunktion — skattning av förväntad framtida belöning från ett tillstånd eller tillstånd–handling-par.

- Modell — (i modellbaserade metoder) en uppskattning av hur miljön övergår mellan tillstånd och vilka belöningar som följer.

- Tidsdiskontering (gamma) — faktor för att väga framtida belöningar; gör att nära belöningar ofta värderas högre än avlägsna.

Formellt ramverk

Förstärkningsinlärning formuleras ofta som ett Markov Decision Process (MDP), som innehåller mängder av tillstånd, handlingar, övergångssannolikheter och belöningar. Agenten söker en policy som maximerar den förväntade diskonterade summan av belöningar över tid.

Huvudtyper av algoritmer

- Model-free — lär direkt värdefunktioner eller policy utan att modellera miljön (exempel: Q-learning, SARSA, Policy Gradient).

- Model-based — bygger eller lär en modell av miljön och planerar med den (exempel: Dyna, planning med sökträd).

- Value-based — fokuserar på att uppskatta värdet av tillstånd eller tillstånd–handling-par (exempel: Q-learning, DQN).

- Policy-based — optimerar direkt parametriserade policies (exempel: REINFORCE, PPO).

- Actor–Critic — kombinerar policy (actor) och värdefunktion (critic) för stabilare inlärning (exempel: A2C, A3C).

- Deep RL — använder neurala nätverk för att approximera policy eller värdefunktioner och har möjliggjort framsteg i komplexa uppgifter som spel och robotik.

Utforskning vs. utnyttjande

En central princip är balansen mellan utforskning (pröva nya handlingar för att lära mer) och utnyttjande (använda den kunskap som finns för att få belöning). Vanliga strategier är:

- ε-greediness — väljer slumpmässigt med sannolikhet ε, annars bästa kända handling.

- Softmax/boltzmann — sannolikhetsbaserat urval beroende på uppskattade värden.

- Optimism i början och upper confidence bounds — tekniker som uppmuntrar utforskning när osäkerheten är stor.

Tillämpningar

Förstärkningsinlärning används i många områden där sekventiella beslut är viktiga:

- Spel: schack, Go och dator- och brädspel där RL kombinerat med sökmetoder nått toppnivåer.

- Robotik: rörelseplanering, greppning och adaptiva rörelsekontroller.

- Rekommendationssystem: sekventiella rekommendationer och anpassning till användarbeteenden.

- Autonoma fordon: beslutsfattande i realtid och planering under osäkerhet.

- Affärs- och finanssystem: portföljoptimering, dynamisk prissättning.

- Hälsovård: behandlingsplanering och adaptiva interventioner (forskning pågår).

Utmaningar och begränsningar

- Provkrävande — många RL-metoder behöver stora mängder data och interaktioner för att lära.

- Belöningsdesign — felaktigt formulerade belöningar kan leda till oönskade beteenden (reward hacking).

- Stabilitet och konvergens — särskilt med funktionapproximation kan inlärning bli instabil.

- Säkerhet och etik — i verkliga system måste säkerhetskrav och etiska begränsningar beaktas.

- Delvis observerbara miljöer — när agenten inte ser hela tillståndet behövs speciella metoder (POMDP, minne).

- Sim‑to‑real — överföring från simulering till verkliga system är ofta svår.

Praktiska råd

- Använd simulering för snabb iteration och för att minska kostnaden för prov.

- Designa belöningar noggrant och överväg att använda sparsamma eller hierarkiska belöningar.

- Normalisera observationer och belöningar, använd lämpliga baslinjer för policy-gradienter för att minska varians.

- Prova enklare baslinjer först (t.ex. tabellmetoder, grundläggande Q-learning) innan du går över till komplex deep RL.

- Övervaka beteenden kontinuerligt för att upptäcka oönskade lösningar tidigt.

För den som vill fördjupa sig rekommenderas att studera MDP-teori, klassiska algoritmer (Q-learning, SARSA), samt moderna metoder inom deep RL. Fältet utvecklas snabbt och kombinationen av teorin från beteendepsykologi och tekniker från maskininlärning fortsätter att ge nya framsteg.