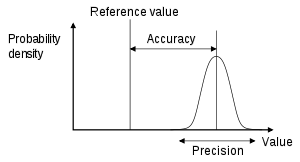

Begreppen noggrannhet och precision beskriver två olika aspekter av hur bra mätningar och mätinstrument fungerar. Kortfattat anger noggrannhet hur nära ett mätvärde ligger det sanna eller refererade värdet, medan precision anger hur väl upprepade mätningar överensstämmer med varandra. Dessa begrepp används inom områden som mätsystem, vetenskap, teknik, industri och statistik för att värdera mätkvalitet.

Definitioner och skillnader

Noggrannhet handlar om avvikelsen mellan medelvärdet av upprepade mätningar och det verkliga värdet. Precision uttrycker spridningen hos upprepade mätningar, ofta mätt med standardavvikelse eller variationskoefficient. Ett instrument kan vara mycket precist (lågt sprid) men samtidigt systematiskt felaktigt (dålig noggrannhet) om alla mätningar ligger felaktigt förskjutna i samma riktning. Motsatsen — korrekt men oprecis — innebär att medelvärdet ligger nära sanningen men varje mätning varierar mycket.

Typer av fel och relaterade begrepp

Vid bedömning av mätningar är det vanligt att särskilja:

- Systematiska fel (bias) — icke-slumpmässiga avvikelser som kan bero på kalibrering, metodfel eller felaktiga antaganden. Relaterade begrepp diskuteras ofta i samband med bias.

- Slumpmässiga fel — naturlig variation från mätning till mätning; påverkar precisionen.

- Giltighet — ett mått på att ett mätsystem är både korrekt och precist; beskriver ofta om mätningen verkligen mäter det avsedda fenomenet.

Systematiska fel påverkar i första hand noggrannheten och kan ofta identifieras och korrigeras genom jämförelse mot referenser eller kalibrering. Slumpmässiga fel minskar i betydelse med fler upprepade mätningar, vilket förbättrar precisionen men inte tar bort ett konstant bias.

Praktiska exempel och tolkning

Föreställ dig ett skyttemål: pilar som träffar tätt samlade men bortanför mittpunkten illustrerar hög precision men låg noggrannhet. Om pilarna däremot ligger spridda men med medelvärdet nära mittpunkten är noggrannheten god men precisionen dålig. Inom laboratoriemätningar kan en våg vara välkalibrerad (bra noggrannhet) men känslig för vibrationer (dålig precision). I statistik används mått som medelvärde och standardavvikelse för att kvantifiera dessa egenskaper.

Hur man förbättrar mätningar

Åtgärder för att höja kvaliteten kan vara:

- Kalibrering mot spårbara referenser för att minska systematiska avvikelser.

- Öka antalet upprepningar för att bättre uppskatta och minska slumpmässiga fel och öka precisionen.

- Förbättra mätmetodik och utbilda operatörer för att motverka metodfel och mänskliga felkällor (fel i experimentutförande).

- Dokumentation av mätosäkerhet och osäkerhetskällor för att bedöma giltighet och tillförlitlighet.

Betydelse och användning

Att förstå och skilja mellan noggrannhet och precision är centralt för att tolka resultat korrekt i forskning, produktion och kvalitetskontroll. Exempelvis kan ökad provstorlek förbättra statistisk precision men inte avhjälpa ett systematiskt fel som beror på metodval. För analys och beslutsfattande är det viktigt att både kvantifiera variabilitet och att identifiera potentiella källor till bias.

Vid praktisk tillämpning kombineras ofta statistiska metoder och tekniska åtgärder: mätdata analyseras med statistiska verktyg för att uppskatta precision, medan teknisk kalibrering och metodutveckling syftar till att förbättra noggrannheten. För fördjupning i mätteknik och statistik se relevanta resurser och standarder via industriella och tekniska riktlinjer eller rekommendationer från ackrediteringsorgan (vetenskaplig praxis).